山田G-研究プロジェクト

How Adaptation and User Engagement Affect Trust in Audio Guide Agents

2025-05-06

斉藤 真理 Mari Saito (SONY), 山田 誠二 Seiji Yamada (NII/SOKENDAI)

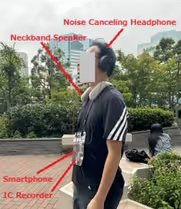

本論文では,ユーザーエンゲージメントがユーザーがオーディオガイドエージェントの環境適応能力に対する信頼にどのように影響するかを説明しています.オーディオガイドエージェントは,ユーザーの行動を妨げずに機能するため,今後さらに広く利用されることが期待されています.エージェントが環境に適応し,ユーザーと協働して機能するため,エージェントに対する信頼は重要です.したがって,適応そのものが信頼に影響を与えるか,ユーザーエンゲージメントの手段として意図的なユーザー操作が信頼に影響を与えるかを調査しました.2つの独立変数(環境ノイズへの適応度とユーザー操作の有無)を要因とする参加型実験を実施し,エージェントの印象に関する主観的評価を従属変数としました.適応性の要因では,ノイズキャンセリング性能が低いエージェントと高いエージェントを提供しました.ユーザーエンゲージメントの要因では,環境ノイズのボリューム調整機能を提供するか否かを設定しました.環境音が制御された実験室環境において,エージェントの環境適応度が低い場合のみ,ユーザーがエージェントをより知能的で人間らしいと認識することが確認されました.しかし,エージェントの適応度は信頼を増加させ,ユーザーエンゲージメントもエージェントの適応度に関わらず信頼を増加させました.一方,現実の環境では,適応は信頼を増加させる傾向にありました.しかし,ユーザーエンゲージメントは信頼に影響を与えませんでした.これは,現実の環境におけるユーザーの認知負荷の影響によるもので,参加者が意図した通りに操作できない状況下でも,操作可能な条件下でさえ,その影響が妨げられた可能性が考えられます.ユーザーとエージェントが協働するシステムでは,ユーザーが適切に操作できる場合,ユーザーエンゲージメントを意図的に増加させることで,エージェントへの信頼が向上する可能性が示唆されています.

Empirical investigation of how robot’s pointing gesture influences trust in and acceptance of heatmap-based XAI

2023-04-10

前東 晃礼 Akihiro Maehigashi(静岡大学),福地 庸介 Yosuke Fukuchi(NII),山田 誠二 Seiji Yamada(NII/総研大)

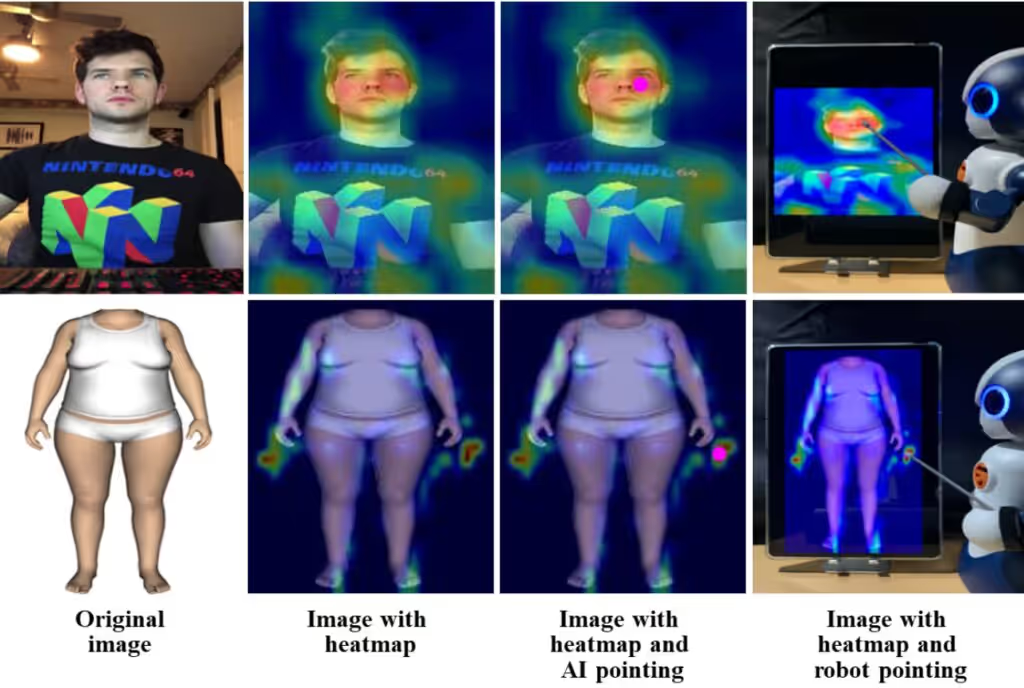

本研究では,ロボットの注意ヒートマップを表示しながらロボットがポイントジェスチャーを行うことが,ロボットの出力に対する人間の信頼や受容にどのような影響を与えるかを検討した.我々は,2種類の視覚タスクを用いた実験を実施した.これらのタスクでは,参加者はAIやロボットの回答を受け入れるか拒否するかを決定する必要があった.参加者は,AI注目ヒートマップ,AIポインティング付きヒートマップ(レーザードットカーソルとして表示),ロボットポインティング付きロボット注目ヒートマップ(棒付きタブレットに表示されたヒートマップの特定の場所をポインティング),またはヒートマップなしで回答を見ることができました.実験の結果,より難易度の高い課題において,ヒートマップの解釈可能性が低い場合,AIとロボットによる注意ヒートマップの指差しが,参加者の回答の受容性を低下させることが明らかになりました.また,ロボットがヒートマップを指差すことで,より難しいタスクでヒートマップの解釈可能性が高い場合,その答えの受容性が高まる可能性が示されました.さらに,ロボットの回答に対する受容性は,ロボットに対する感情的信頼と相関していた.本研究は,ロボットが注目ヒートマップを指し示すジェスチャーを用いることで,人間とロボットの相互作用における人間の行動や感情的信頼を制御できる可能性を示している.

Dynamic Selection of Reliance Calibration Cues With AI Reliance Model

2023-04-09

福地 庸介 Yosuke Fukuchi(NII),山田 誠二 Seiji Yamada(NII/総研大)

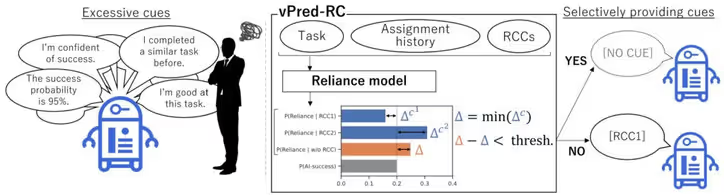

意思決定に機械学習を応用した知的エージェントと人間が効果的に協働するためには,人間がエージェントにできること,できないことを理解し,過不足のない依存を避ける必要があります.この問題の解決策として,人間がエージェントの能力を評価するのに役立つRCC(Reliance Calibration Cue)を用いたコミュニケーションを通じて,人間の信頼度を調整することが挙げられます.これまでの研究では,RCCを継続的に提示することで信頼度を校正することが一般的であったが,エージェントがいつRCCを提供すべきかは未解決のままである.そこで,我々は,RCCを選択的に提供する手法であるPred-RCを提案する.Pred-RCは,認知的信頼性モデルを用いて,人間がエージェントにタスクを割り当てるかどうかを予測する.RCCがある場合とない場合の予測結果を比較することで,RCCが人間の信頼性に与える影響を評価する.Pred-RCを人間とAIのコラボレーションタスクでテストしたところ,RCCの数を減らしても人間の信頼性をうまく較正できることがわかった.

Modeling Reliance on XAI Indicating Its Purpose and Attention

2023-03-10

前東 晃礼 Akihiro Maehigashi (静岡大学),福地 庸介 Yosuke Fukuchi(NII),山田 誠二 Seiji Yamada(NII/SOKENDAI)

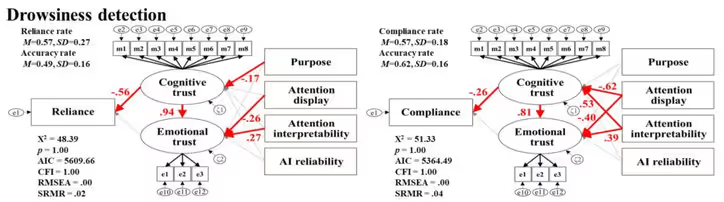

本研究では,そのプロセスの説明として目的や注目度を示すXAIを用い,これらの説明が人間のAIに対する信頼や利用にどのような影響を与えるかを調査した.本研究では,AIの注意を示すヒートマップを生成し,ヒートマップの解釈可能性の妥当性を確認する実験1を行い,目的およびヒートマップが依存(AIに依存する)および遵守(AIの回答を受け入れる)に与える影響を調べる実験2を実施した.構造方程式モデリング(SEM)分析の結果,(1)AIの利用目的表示は,AIの利用形態,依存・遵守,タスクの難易度によって信頼に正負の影響を与えること,(2)より難しいタスクではヒートマップを表示するだけで信頼に負に影響,(3)より難しいタスクではヒートマップの解釈性によって信頼に正の影響を与えることがわかった.

Influence of agent’s self-disclosure on human empathy

2023-03-10

津村 賢宏 Takahiro Tsumura (SOKENDAI/NII), 山田 誠二 Seiji Yamada (NII)

AI技術の進歩に伴い,人間社会にAIをより多く応用するためには,知的なバーチャルエージェントやロボットなどのAIエージェントの社会的受容がより重要になってきている.人間と擬人化されたエージェントの関係を改善する一つの方法は,人間にエージェントに共感してもらうことである.共感することで,人間はエージェントに対してポジティブで親切な行動をとるようになり,エージェントを受け入れやすくなる.本研究では,擬人化されたエージェントに対する人間の共感を高めるために,エージェントから人間への自己開示に着目する.エージェントからの自己開示が人間の共感を促進する可能性を実験的に検討する.仮説を立て,人間がエージェントに対してより多くの共感を得る条件を実験的に分析・考察する.実験は三者混合計画で行い,因子はエージェントの外見(人間,ロボット),自己開示(高関連自己開示,低関連自己開示,自己開示なし),ビデオ刺激の前後での共感とした.918名の参加者のデータを用いて分散分析(ANOVA)を行った.その結果,外見要因には主効果がなく,使用したシナリオとの関連性が高い自己開示は,統計的に有意な差をもって,より人間的な共感を促進することがわかった.また,自己開示がない場合は,共感が抑制されることがわかった.これらの結果は,我々の仮説を支持するものである.本研究により,自己開示は擬人化エージェントの重要な特徴であり,人間が擬人化エージェントを受け入れるのに役立つことが明らかになった.

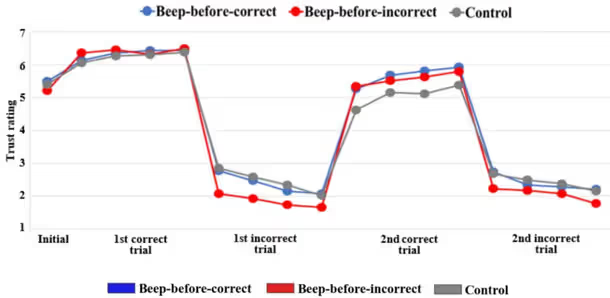

Impacts of Robot Beep Timings on Trust Dynamics in Human-Robot Interaction

2022-10-10

前東 晃礼 Akihiro Maehigashi (静岡大学),津村 賢宏 Takahiro Tsumura (SOKENDAI/NII),山田 誠二 Seiji Yamada(NII/SOKENDAI)

本研究では,社会的ロボットの擬人化と機械的特徴の組み合わせが人間の信頼に与える影響を調査した.特に,擬人化された身体性を持つ社会的ロボットが発するビープ音が,人間のロボットに対する信頼にどのように影響するかに注目した.ビープ音は,ロボットがタスクパフォーマンスの高低を示す直前に提示されるように実験的に操作された.その結果,(1)高パフォーマンス直前の音は,ロボットが正確に動作したときの信頼を高め,(2)低パフォーマンス直前の音は,ロボットが不正確に動作したときの信頼をより低下させ,また正確に動作したときの信頼をより高めることがわかった.また,同じビープ音を提示しても,タイミングによって人間の信頼感に与える影響が異なることがわかった.この結果をもとに,人間とロボットのインタラクションにおける信頼をデザインするための可能な方法について議論する.